360-Grad-Video erfasst alles auf einmal – aber aus rohem Dual-Fisheye-Material etwas analytisch Verwertbares und Veröffentlichungsfähiges zu machen, erfordert eine Pipeline aus aufeinander abgestimmten Werkzeugen. Bei adagger haben wir eine solche Pipeline in mehreren Bereichen aufgebaut und eingesetzt: vom Sportcoaching über Industrieinspektion bis hin zu Eventdokumentation. Dieser Artikel beschreibt jeden Schritt: sauberes Stitching mit dem SDK des Kameraherstellers, die Anwendung von Machine-Learning-Modellen zur Gewinnung strukturierter Daten aus dem Footage, die Vorschau und Stabilisierung des Ergebnisses in einem browserbasierten Werkzeug sowie den Export in die Formate, die grosse Plattformen erwarten.

Der Ansatz ist nicht an einen einzelnen Anwendungsfall gebunden. Ob die Kamera an der Mastspitze einer Segeljolle, an einem Helm beim Radrennen, an einem Mast über einer Baustelle oder in einem Einzelhandelsraum montiert ist – die Verarbeitungsschritte sind dieselben. Was sich ändert, sind das trainierte Modell und die abzuleitenden Metriken.

Schritt 1: Sauberes Stitching mit dem Hersteller-SDK

Der erste und grundlegendste Schritt ist das Zusammenfügen der beiden Fisheye-Objektive zu einem einzelnen equirectangularen Frame. Wenn dieser Schritt schlecht ausgeführt wird, leidet alles Nachfolgende: Object-Detection-Modelle erzeugen geteilte Detektionen an der Stitch-Naht, Keypoint-Modelle verlieren Körperteile, die die Nahtlinie überschreiten, und das Video sieht für menschliche Betrachter falsch aus.

Ein verbreiteter Abkürzungsweg ist, rohe Kameradateien mit manuell geschätzten Projektionsparametern durch FFmpeg zu schleusen. Das erzeugt zwar ein technisch valides equirectangulares Bild, aber die Stitch-Qualität hängt vollständig davon ab, wie gut die Parameter zur physikalischen Linsengeometrie des jeweiligen Kameramodells passen. Das Ergebnis ist oft eine sichtbare Naht, eine Farbabweichung zwischen den beiden Hälften oder geometrische Verzerrungen an den Polen. Diese Artefakte sind in der Nachbearbeitung schwer zu korrigieren und beeinträchtigen die Modellgenauigkeit genau in den Bereichen – an den Rändern jedes Objektivs –, in denen interessante Objekte häufig erscheinen.

Der richtige Ansatz ist die Verwendung des Hersteller-SDK, das die im jeweiligen Kamerakörper gespeicherten Werkskalibrierungsdaten anwendet. Das SDK kennt die genauen Linsenparameter, den Abstand zwischen den Objektiven und die Sensoreigenschaften für jedes Modell. Hersteller wie Insta360, GoPro (MAX), Ricoh (Theta) und Kandao stellen jeweils SDKs oder Verarbeitungsbibliotheken für diesen Zweck bereit. Das Ergebnis ist ein geometrisch korrekter equirectangularer oder fisheye-korrigierter Frame mit einer sauberen Überblendung an der Stitch-Naht und konsistenter Farbgebung über beide Linsen hinweg.

Unsere Pipeline ruft das jeweilige SDK programmatisch auf, sodass das Stitching vollständig automatisiert als Teil des Ingestion-Schritts erfolgt. Rohdateien werden übergeben, das SDK liefert kalibriertes equirectangulares Video zurück – ohne manuelle Parameteranpassung. Das macht die Pipeline auf verschiedene Kameramodelle desselben Herstellers übertragbar: Die kameraspezifische Kalibrierung wird vom SDK übernommen, anstatt einen Satz modellspezifischer FFmpeg-Parameter pflegen zu müssen.

Schritt 2: Perspektivische Umprojektion

Die equirectangulare Projektion eignet sich gut für Speicherung und Übertragung, erzeugt aber erhebliche Verzerrungen – insbesondere an den Polen und an den Bildrändern. Machine-Learning-Inferenz direkt auf equirectangularen Frames auszuführen, verschlechtert die Genauigkeit bei Objekten in Bereichen mit hoher Verzerrung, und die meisten Modelle wurden auf konventionellen geradlinigen Bildern ohne diese Verzerrung trainiert.

Nach dem Stitching projiziert die Pipeline relevante Bereiche in geradlinige perspektivische Ausschnitte um. Die Blickrichtung und das Sichtfeld jedes Ausschnitts sind konfigurierbar. Bei einer Mastspitzen-Anwendung im Segeln extrahieren wir beispielsweise einen vorwärts gerichteten Ausschnitt auf den Segler, einen weiteren für die vorausfahrende Flotte und einen äquatorialen 360-Grad-Streifen für das Flotten-Tracking. Bei einer helmmontierten Kamera deckt ein vorwärts gerichteter Ausschnitt die Strasse ab, ein rückwärts gerichteter den nachfolgenden Verkehr. Die Umprojektion wird analytisch aus den equirectangularen Koordinaten berechnet und fügt vernachlässigbaren Verarbeitungsaufwand hinzu.

Schritt 3: Machine-Learning-Inferenz

Mit sauberen, gut projizierten Frames können Machine-Learning-Modelle zuverlässig angewendet werden. Unsere Pipeline unterstützt zwei primäre Modelltypen, die oft gemeinsam in einer gemeinsamen Inferenzschleife ausgeführt werden.

Object Detection

Object-Detection-Modelle identifizieren und lokalisieren Instanzen definierter Objektklassen in jedem Frame. Im Segelkontext bedeutet das die Erkennung von Jollenrümpfen; im Baustellenkontext können das Arbeiter, Fahrzeuge oder Ausrüstung sein; im Einzelhandel Kunden oder Produktplatzierungen. Wir verwenden eine YOLOv8-basierte Architektur, die effizient auf CPU und GPU läuft.

Detektionen werden über Frames hinweg mit einem Multi-Object-Tracker verknüpft – wir verwenden ByteTrack –, um kontinuierliche Trajektorien zu erzeugen. Aus diesen Trajektorien lassen sich abgeleitete Metriken wie Entfernungsschätzungen, Annäherungsgeschwindigkeiten, Verweildauern und Positionsbeziehungen zwischen verfolgten Objekten automatisch berechnen.

Keypoint Detection

Keypoint-Detection-Modelle identifizieren die Positionen semantisch bedeutungsvoller Landmarken innerhalb eines Objekts – Körpergelenke bei einer Person, anatomische Referenzpunkte bei einem Tier oder Strukturmerkmale bei einem Fahrzeug. Aus diesen Landmarkpositionen lassen sich eine Vielzahl abgeleiteter Metriken berechnen: Gelenkwinkel, Gliedmassenstreckungen, Haltungswerte und zeitliche Metriken wie Reaktionszeiten und Bewegungskonsistenz.

Standard-Pose-Estimation-Modelle, die auf konventionellen Fotografien trainiert wurden, lassen sich nicht gut auf ungewöhnliche Kamerawinkel übertragen – eine Mastspitzenkamera, die von oben auf einen Segler schaut, erzeugt eine ungewohnte Perspektive. Wir verwenden eine benutzerdefinierte Keypoint-Trainingspipeline mit Transfer Learning von einem Basis-Pose-Modell, das auf einem Datensatz aus Frames des Zielkamerawinkels feinabgestimmt wird. Bereits einige hundert annotierte Frames reichen für ein zuverlässiges Modell für einen spezifischen Blickwinkel aus, da die Hintergrundvariation begrenzt und die Kameraposition fest ist.

Schritt 4: Browserbasierte Vorschau, Stabilisierung und Export

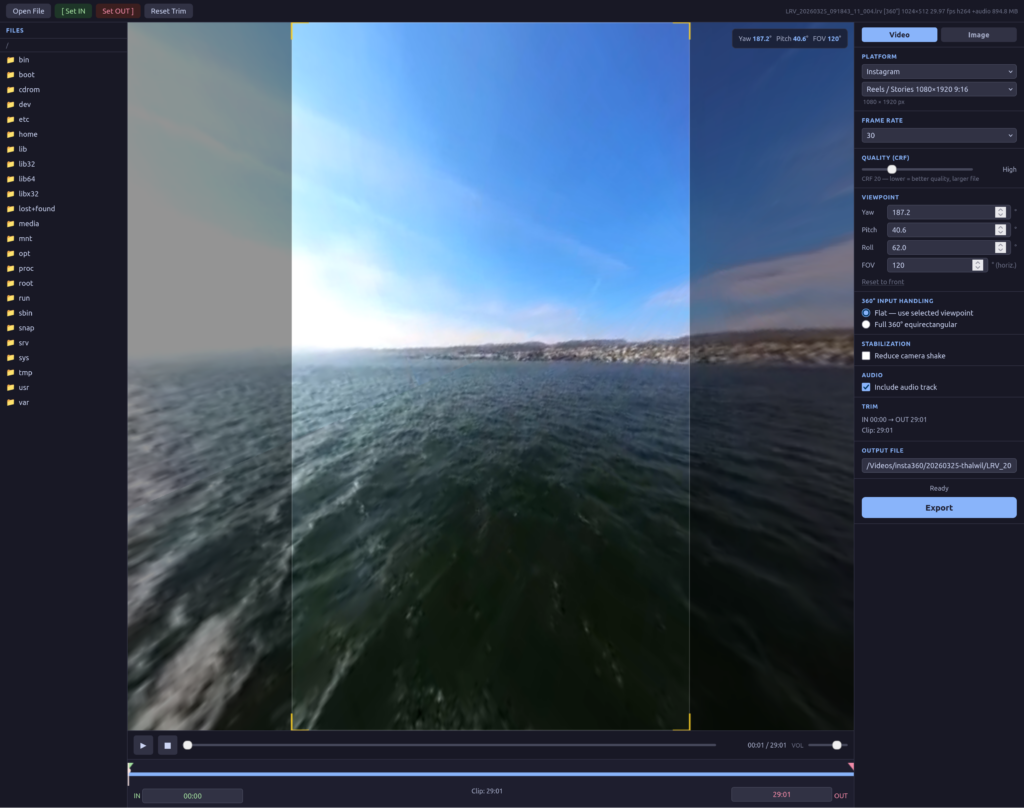

Rohes 360-Grad-Footage, das von einer bewegten Plattform aufgenommen wurde – einem Boot, einem Fahrzeug, einer rennenden Person –, ist fast immer verwackelt. Ohne Stabilisierung ist das Footage desorientierend anzuschauen und die Bewegung erschwert die Machine-Learning-Inferenz. Wir haben ein browserbasiertes Werkzeug entwickelt, das Vorschau, Stabilisierung und Export in einer einzigen Oberfläche vereint.

Interaktive Vorschau

Das Vorschauwerkzeug lädt equirectangulares Video und stellt es im Browser als interaktive sphärische Ansicht mit WebGL dar. Der Nutzer kann in jede Richtung schwenken, das Sichtfeld anpassen und zu jeder Stelle im Footage springen. Das macht es praktisch, lange Aufnahmen zu überprüfen, ohne grosse Dateien herunterladen oder Desktop-Software installieren zu müssen. Das Werkzeug zeigt auch alle Annotationen aus der Machine-Learning-Pipeline an – Bounding Boxes, Keypoint-Overlays und abgeleitete Metrik-Anzeigen – in Echtzeit auf der sphärischen Ansicht.

Stabilisierung

Der Stabilisierungsschritt schätzt die rotatorische Bewegung der Kamera über Frames hinweg und wendet eine kompensierende Rotation auf jeden Frame an, wodurch hochfrequente Erschütterungen entfernt werden, während beabsichtigte langsame Schwenks erhalten bleiben. Der Algorithmus arbeitet in sphärischen Koordinaten, was die Randartefakte vermeidet, die bei der Stabilisierung von flachem Video auftreten. Ein Glättungsfenster ist konfigurierbar, sodass der Kompromiss zwischen Verwacklungsreduktion und dem Folgen beabsichtigter Kamerabewegungen für den jeweiligen Anwendungsfall eingestellt werden kann. Das Ergebnis ist Footage, das angenehm anzusehen ist und einen stabilen Horizont zeigt – wichtig sowohl für das Zuschauererlebnis als auch für die Modellgenauigkeit.

Export in Social-Media-Formate

Verschiedene Plattformen haben unterschiedliche Anforderungen an 360-Grad-Video. YouTube erwartet equirectangulares MP4 mit spezifischen XMP-Spatial-Metadaten im Container, damit die Plattform den 360-Grad-Viewer aktiviert. Instagram unterstützt 360-Grad-Wiedergabe nicht nativ und erwartet stattdessen einen konventionellen flachen geradlinigen Ausschnitt – typischerweise ein 1:1- oder 4:5-Frame aus der equirectangularen Quelle. Andere Plattformen haben eigene Seitenverhältnisse und Codec-Anforderungen.

Das Export-Werkzeug übernimmt all das automatisch. Der Nutzer wählt eine Zielplattform – YouTube, Instagram, TikTok oder einen allgemeinen Download –, und das Werkzeug wendet die korrekte Projektion, das richtige Seitenverhältnis, die passenden Bitraten-, Codec-Einstellungen und Metadaten an. Für YouTube wird die vollständige equirectangulare Ausgabe mit eingebetteten 360-Grad-Metadaten erzeugt. Für Instagram und TikTok wird ein geradliniger Ausschnitt aus einer konfigurierbaren Blickrichtung berechnet, mit Seitenverhältnis und Auflösung entsprechend den Plattformvorgaben. Das stabilisierte Footage wird als Quelle für alle Exporte verwendet, sodass verwackeltes Quellmaterial nicht in die veröffentlichte Ausgabe übernommen wird.

Die vollständige Pipeline im Überblick

Von Anfang bis Ende bewegt sich die Pipeline von rohen Kameradateien durch folgende Schritte bis zur fertigen, annotierten Ausgabe:

- Ingestion und Stitching – rohe Kameradateien werden dem Hersteller-SDK übergeben (z. B. dem Insta360 SDK für Insta360-Kameras), das ein kalibriertes equirectangulares MP4 mit sauberer Stitch-Naht zurückliefert.

- Umprojektion – geradlinige perspektivische Ausschnitte werden in konfigurierbaren Richtungen und Sichtfeldern aus dem equirectangularen Frame extrahiert, um Verzerrungen in relevanten Bereichen zu reduzieren.

- Inferenz – Object-Detection- und Keypoint-Detection-Modelle laufen auf den umprojizierten Ausschnitten; Detektionen werden in sphärische Koordinaten zurückgemappt und über Frames verfolgt.

- Stabilisierung – rotatorische Bewegung wird geschätzt und in sphärischen Koordinaten kompensiert, was gleichmässiges Footage für Überprüfung und Veröffentlichung erzeugt.

- Vorschau und Überprüfung – das browserbasierte Werkzeug stellt das stabilisierte Footage als interaktive sphärische Ansicht mit Annotation-Overlays dar und ermöglicht eine effiziente Überprüfung langer Aufnahmen.

- Export – das Werkzeug exportiert in Zielplattform-Formate: equirectangular mit 360-Grad-Metadaten für YouTube, geradlinige Ausschnitte für Instagram und TikTok oder benutzerdefinierte Ausschnitte für andere Verwendungszwecke.

Praktische Herausforderungen

Bewegte Plattform und Rolling Shutter

Kameras an schnell bewegten Plattformen – Bootsmasten, Helmen, Fahrzeugen – erzeugen erhebliche Bewegungsunschärfe und Rolling-Shutter-Verzerrungen bei schnellen Bewegungen. Eine Frame-Auswahllogik, die Momente mit geringerer Bewegung bevorzugt, reduziert die Auswirkungen auf die Inferenzqualität. Datenaugmentierung während des Trainings, die Bewegungsunschärfe und geneigte Horizonte simuliert, verbessert die Robustheit des Modells gegenüber diesen Bedingungen.

Wechselnde Lichtverhältnisse

Aussenaufnahmen mit 360-Grad-Kameras umspannen ein breites Spektrum an Lichtverhältnissen innerhalb einer einzigen Aufnahme – heller Himmel, Schatten, Wasserreflexionen, Linsenblendung. Starke Datenaugmentierung während des Trainings (Helligkeit, Kontrast, Farbton, zufällige Schatten) ist die wirksamste Massnahme. Wenn die Pipeline als Dienst läuft, hilft auch eine Normalisierung auf Frame-Ebene vor der Inferenz.

Stitch-Naht und Modellgenauigkeit

Selbst bei SDK-Qualitäts-Stitching kann der äquatoriale Bereich, wo die beiden Objektive aufeinandertreffen, bei schwierigen Lichtverhältnissen subtile Farbverläufe oder Mikroüberblendungsartefakte erzeugen. Für Anwendungen, bei denen Detektionen nahe der Naht kritisch sind, liefert die unabhängige Verarbeitung überlappender perspektivischer Ausschnitte jedes Objektivs – mit anschliessender Zusammenführung der Detektionen via Non-Maximum-Suppression – bessere Ergebnisse als die direkte Arbeit mit dem gesticchten equirectangularen Frame.

Massstabskalibrierung

Die Entfernungsschätzung aus visuellen Detektionen erfordert eine bekannte Massstabsreferenz. Wenn GPS-Daten der Kamera verfügbar sind, können sie mit dem visuellen Tracking fusioniert werden, um die Entfernungsgenauigkeit zu verbessern. Wenn nicht, liefert ein bekanntes Referenzobjekt in der Szene – ein Rumpf mit bekannter Länge, ein Fahrzeug mit bekannten Abmessungen – eine Pixel-pro-Meter-Kalibrierung, die aus einer kleinen Anzahl annotierter Kalibrierungsframes berechnet wird.

Anwendungsfälle

Die hier beschriebene Pipeline ist domänenunabhängig. Wir haben sie oder Teile davon in folgenden Bereichen eingesetzt:

- Sportcoaching – 360-Grad-Mastspitzen-Video an Jollen für Körperpositionsanalyse, Flottenverfolgung und taktische Überprüfung; helmgestützte Kameras beim Radfahren für Strassenpositions- und Konkurrentenverfolgung

- Industrieinspektion – mastmontierte 360-Grad-Kameras an Produktionslinien und Baustellen für Arbeitssicherheitsmonitoring, Geräteverfolgung und Fortschrittsdokumentation

- Eventdokumentation – 360-Grad-Kameras bei Sportveranstaltungen und Konferenzen mit automatischer Highlight-Erstellung und Multi-Plattform-Export

- Einzelhandels- und Raumanalyse – deckenmontierte 360-Grad-Kameras für Kundenstromanalyse, Verweildauermessung und Planogramm-Compliance-Überprüfung

In jedem Fall wird die Kernpipeline – Hersteller-SDK-Stitching, Umprojektion, Inferenz, Stabilisierung, Browservorschau, Plattform-Export – wiederverwendet. Die domänenspezifische Arbeit sind die annotierten Trainingsdaten und die Metrikdefinitionen.

Jetzt loslegen

Wenn Sie 360-Grad-Videodaten haben und eine Performance- oder Analysefrage beantwortet haben möchten, sprechen wir gerne darüber, wie eine massgeschneiderte Pipeline für Ihren spezifischen Kontext aussehen könnte. Wir haben Erfahrung im Aufbau von Sports-Analytics-MVPs, benutzerdefinierten Keypoint-Detection-Modellen und automatisierten Sichtprüfungssystemen vom ersten Konzept bis zur Produktionsbereitstellung.

Nehmen Sie Kontakt mit dem adagger-Team auf, um Ihr Projekt zu besprechen.